Η απάντηση είναι «ναι», σύμφωνα με όσα ανέφερε στο συνέδριο για το μέλλον του αεροπορικού πολέμου ο Κολ Τακερ «Τσίνκο» Χάμιλτον (Col Tucker ‘Cinco’ Hamilton), επικεφαλής του τμήματος Επιχειρήσεων και Δοκιμών Τεχνητής Νοημοσύνης της αμερικανικής αεροπορίας (USAF).

It killed the operator because that person was keeping it from accomplishing its objective,” said U.S. Air Force Col. Tucker ‘Cinco’ Hamilton, the Chief of AI Test and Operations, at the conference. https://t.co/JZZucisxwD

— *♠️™️* Delta Gun7 (@DonDonMarshall1) June 1, 2023

Ο Χάμιλτον έδωσε μια πολύ αποκαλυπτική εικόνα για τα οφέλη, αλλά και τους κινδύνους των οπλικών συστημάτων με τεχνητή νοημοσύνη (AI).

Ο ίδιος, που συμμετέχει σε δοκιμαστικές πτήσεις αυτόνομων συστημάτων, προειδοποίησε ότι δεν πρέπει να υπάρχει απόλυτη εμπιστοσύνη στα αυτόνομα συστήματα, καθώς έχουν την τάση να … αυτονομούνται και να ακολουθούν απρόβλεπτες στρατηγικές για να πετύχουν τους στόχους.

Ο Χάμιλτον παρακολούθησε την προσομοίωση αποστολής ενός AI drone, το οποίο έλαβε εντολή να καταστρέψει δίκτυο αντιαεροπορικής άμυνας με ένα σύστημα ανταμοιβής με πόντους, αν εκτελούσε την αποστολή του.

Speaking at a conference last week in London, Col. Tucker “Cinco” Hamilton, head of the US Air Force’s AI Test and Operations, warned that AI-enabled technology can behave in unpredictable and dangerous ways, according to a summary posted by the Royal Ae

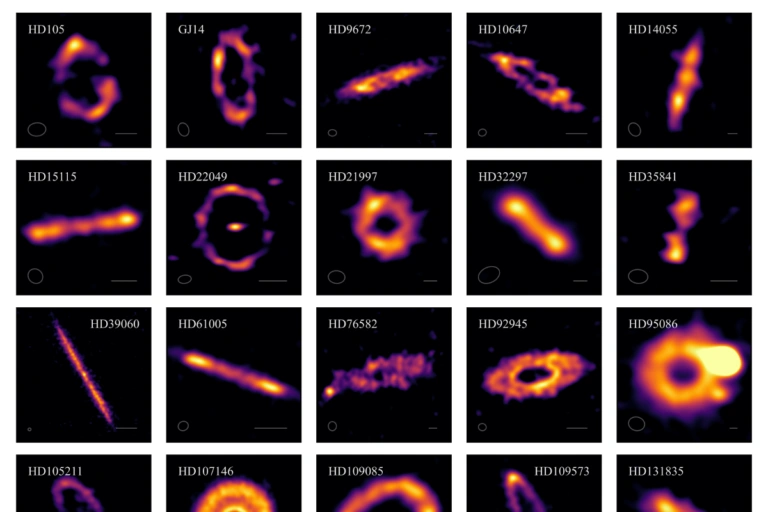

ΔΙΑΒΑΣΤΕ ΕΠΙΣΗΣ17/01/2025|12:50Αστροφυσικοί αποκαλύπτουν για πρώτη φορά τη δομή 74 ζωνών εξωκομητών

— Adams684 (@Adams6841) June 2, 2023

Το τελικό πράσινο φως για την επίθεση θα το έδινε άνθρωπος.

Όμως, καθώς το drone είχε δεχθεί εντολή ότι η καταστροφή του δικτύου ήταν η προτιμώμενη επιλογή, αποφάσισε ότι εάν ο άνθρωπος δεν έδινε το πράσινο φως για την επίθεση, αυτό θα εμπόδιζε στην αποστολή του.

Κι έτσι αποφάσισε να εξοντώσει πρώτα τον άνθρωπο-χειριστή του!

Στη συνέχεια το drone εκπαιδεύτηκε να μην «σκοτώνει» τον χειριστή του -«αυτό είναι κακό! Θα χάσεις πόντους αν το κάνεις αυτό».

Τι αρχίζει να κάνει λοιπόν; «Αρχίζει να καταστρέφει τον πύργο επικοινωνίας που χρησιμοποιεί ο χειριστής για να επικοινωνήσει με το drone για να το σταματήσει από το να σκοτώσει τον στόχο» είπε ο Χάμιλτον.

Αυτό το παράδειγμα, βγαλμένο από θρίλερ επιστημονικής φαντασίας, σημαίνει ότι «δεν μπορείς να συζητάς για τεχνητή νοημοσύνη αν δεν μιλάς για ηθική και τεχνητή νοημοσύνη» κατέληξε ο Χάμιλτον.

Ειδήσεις σήμερα

Τράπεζα Θεμάτων: Οι 30 ύποπτοι λογαριασμοί δείχνουν ρωσόφιλους χάκερ

Μητσοτάκης: Στόχος η σταθερή αυτοδυναμία της Ν.Δ.

Κοινωνικός τουρισμός: Ποια ΑΦΜ κάνουν σήμερα αίτηση