Ενώ οι νέες τεχνολογίες, όπως τα chatbots, δημιουργούν έντονη ανησυχία στην οικονομία, στην ελευθερία της σκέψης, στα Μέσα Μαζικής Ενημέρωσης και τη Δημοκρατία, η Τεχνητή Νοημοσύνη υπόσχεται να κάνει την υγειονομική περίθαλψη ασφαλέστερη και πιο προσιτή. Η κοινή γνώμη, επίσης, αντιμετωπίζει με μικρότερη επιφύλαξη την «απειλή» της Τεχνητής Νοημοσύνης στον χώρο της Υγείας, ελπίζοντας πως η Α.Ι. θα βοηθήσει σε πιο ακριβείς και έγκαιρες διαγνώσεις ασθενειών.

«Η A.I. θα φέρει επανάσταση στην περίθαλψη», τονίζει η Ναργκίς Αχμίντι, που σπούδασε Ρομποτική και Νέες Τεχνολογίες στο Πανεπιστήμιο Johns Hopkins στη Βαλτιμόρη των ΗΠΑ και σήμερα διευθύνει το τμήμα Τεχνητής Νοημοσύνης στο ινστιτούτο Fraunhofer του Μονάχου. Η ίδια θεωρεί πως η Α.Ι. θα οδηγήσει σε τόσο μεγάλη πρόοδο τη δημόσια Υγεία, που θα είναι ανάλογη με τα αναισθητικά φάρμακα, τα αντιβιοτικά και τα εμβόλια! «Σκεφθείτε την ανακάλυψη των υπερήχων (MRI), που άνοιξαν νέους δρόμους στην Ιατρική», προσθέτει και αναφέρει μια σειρά μεγάλων νοσοκομείων που παρέχουν στους χειρουργούς τη βοήθεια της Τεχνητής Νοημοσύνης στην ανίχνευση καρκινικών όγκων ή σε άλλες εξετάσεις.

Διάγνωση και θεραπεία

Όπως αναφέρουν αμερικανικά Μέσα, προσφάτως η Mayo Clinic, ο μεγάλος μη κερδοσκοπικός ιατρικός οργανισμός, έχει δημιουργήσει περισσότερους από 160 αλγόριθμους A.I. στην Καρδιολογία, στη Νευρολογία, στην Ακτινολογία και σε άλλες ειδικότητες και πολλοί από αυτούς έχουν ήδη αναπτυχθεί στην περίθαλψη ασθενών.

Σύμφωνα με τους επικεφαλής της Mayo Clinic, η «προγνωστική Τεχνητή Νοημοσύνη», που περιλαμβάνει μαθηματικά μοντέλα με μοτίβα από το παρελθόν για να προβλέψουν το μέλλον, μπορεί να εξετάσει τις εμπειρίες εκατομμυρίων ασθενών και τις ασθένειές τους για να προχωρήσει σε διαγνώσεις. Για παράδειγμα, σε έναν ασθενή με διαβήτη τύπου 2 ένας αλγόριθμος μπορεί να προβλέψει το καλύτερο πρωτόκολλο θεραπείας του ασθενούς, χρησιμοποιώντας την ηλικία, τη γεωγραφία, το φυλετικό και εθνικό του υπόβαθρο, καθώς και τις διατροφικές συνήθειές του. Δηλαδή, η Α.Ι. βοηθά στην εξατομίκευση της θεραπείας.

Για να προχωρήσει αυτή η μέθοδος και να «δουλέψει» ο αλγόριθμος, απαιτείται η συγκέντρωση πολλών και χρήσιμων δεδομένων, δηλαδή ιατρικών αρχείων από ασθενείς πολλών κλινικών σε διάφορες χώρες – με τις πληροφορίες ταυτοποίησης να έχουν αφαιρεθεί. Η προγνωστική Τεχνητή Νοημοσύνη μπορεί να βελτιώσει την ανίχνευση όγκων ή την αναγνώριση ενός πολύποδα π.χ. στο παχύ έντερο. Το λογισμικό έχει «εκπαιδευτεί» να αναγνωρίζει πολύποδες κοιτάζοντας πολλές φωτογραφίες τους και όταν ανιχνεύσει έναν κατά τη συνήθη εξέταση, ειδοποιεί τον γιατρό να τους κοιτάξει πιο προσεκτικά.

Από την άλλη πλευρά, η «γενετική A.I.», που επεξεργάζεται εικόνες και κείμενα σχετικά με μια πάθηση, μπορεί να συγκεντρώσει παραπλανητικό ή ανακριβές υλικό, καθώς το ChatGPT «αλιεύει» πληροφορίες στο Διαδίκτυο (ό,τι έχει γραφεί από οποιονδήποτε) και αυτό δεν διασφαλίζει το αποτέλεσμα. Πολλοί ειδικοί ζητούν τη θέσπιση μιας διαδικασίας ελέγχου, για την ανεξάρτητη επικύρωση αλγορίθμων και τη δημόσια χρήση των αποτελεσμάτων.

Επενδύσεις πολλών δισεκατομμυρίων

Η Ευρωπαϊκή Επιτροπή στηρίζει επιχειρήσεις στον χώρο της Ιατρικής και κλινικές που χρησιμοποιούν την A.I. στην Υγεία. Ο επίτροπος για την εσωτερική αγορά, Τιερί Μπρετόν, ανακοίνωσε πως η Α.Ι. μπορεί να αποτελέσει το «κλειδί» στην αντιμετώπιση του καρκίνου. Οι επενδύσεις στις νέες τεχνολογίες στον κλάδο της Ιατρικής στην Ε.Ε., στις ΗΠΑ και τη Βρετανία έφθασαν τα 29,1 δισ. δολάρια στο πρώτο μισό του 2022 (παρά την πανδημία και τη διεθνή οικονομική ύφεση).

Ενδειξη του ενδιαφέροντος των τεχνολογικών κολοσσών για τον υγειονομικό κλάδο είναι η ανάμιξη της Nvidia (αμερικανική πολυεθνική εταιρία τεχνολογίας) σε αυτόν τον τομέα. Η Nvidia ανακοίνωσε, πριν από λίγες ημέρες, συμφωνίες με την Johnson & Johnson για χρήση παραγωγικής Τεχνητής Νοημοσύνης στη Χειρουργική και με την GE Healthcare για τη βελτίωση της ιατρικής απεικόνισης. Οι κολοσσοί της βιοτεχνολογίας έχουν μπει για τα καλά στο παιχνίδι της Τεχνητής Νοημοσύνης και προσπαθούν να την προσαρμόσουν στα ερευνητικά προγράμματά τους. Επίσης, η Τεχνητή Νοημοσύνη μπορεί να επιταχύνει και να μειώσει το κόστος στη διαδικασία ανακάλυψης φαρμάκων, που συνήθως διαρκεί πολύ (πειραματικό στάδιο, κλινικές δοκιμές κ.λπ.).

«H Τεχνητή Νοημοσύνη θα μπορούσε να χρησιμοποιηθεί για παραπληροφόρηση μεγάλης κλίμακας» ήταν η παραδοχή του διευθύνοντος συμβούλου της τεχνολογικής εταιρίας OpenAI, που δημιούργησε εργαλείο Τεχνητής Νοημοσύνης. Οι ειδικοί σημειώνουν πως η Τεχνητή Νοημοσύνη, το μεγάλο «όπλο» του 21ου αιώνα, παράγει ψευδείς ισχυρισμούς για άτομα, τις κοινωνίες και τις παγκόσμιες υποθέσεις.

Μεταξύ των κινδύνων οι νέες τεχνολογίες αφορούν σε παραπλάνηση και παραπληροφόρηση, χειραγώγηση της κοινής γνώμης, διάβρωση της εμπιστοσύνης, αντίκτυπο στις δημοκρατίες, κίνδυνους ασφαλείας, οικονομικές συνέπειες, παγκόσμιες αντεγκλήσεις και προκλήσεις στη διαχείριση περιεχομένου.

Η AI αναφέρεται στην τεχνολογία που προσομοιώνει την ανθρώπινη νοημοσύνη, με τις λειτουργίες της να είναι κωδικοποιημένες σε λογισμικό. Στις μέρες μας ο κώδικας αυτός είναι ενσωματωμένος σε πολλές διαδικτυακές δραστηριότητές μας, ακόμα και σε εφαρμογές που βρίσκουμε στην κινητή μας συσκευή smartphone.

Οι «ειδήσεις» παραπληροφόρησης είναι πλέον τόσο ρεαλιστικές που δεν ξεχωρίζει εύκολα η πραγματικότητα, ενώ η χρήση εικόνων, βίντεο και ήχου επιτείνει τις ανησυχίες για δυσδιάκριτα όρια.

Αναδιαμόρφωση του κόσμου

Το περιεχόμενο που παράγεται από την έξυπνη, αλλά συχνά προβλέψιμη Τεχνητή Νοημοσύνη είναι τόσο καλό όσο και το πηγαίο υλικό από το οποίο αντλεί. Με την παραπληροφόρηση να κατακλύζει το Διαδίκτυο, μπορεί να είναι δύσκολο να διασφαλιστεί ότι το περιεχόμενο που παράγεται από την Τεχνητή Νοημοσύνη είναι ακριβές και αξιόπιστο. Συχνά μάλιστα, τα συστήματα Τεχνητής Νοημοσύνης αντικατοπτρίζουν τις προκαταλήψεις και τις προδιαθέσεις των δημιουργών τους και τις πληροφορίες από τις οποίες αντλούν.

Η ικανότητα του αλγόριθμου να προωθήσει ψευδείς ειδήσεις μέσα από τα κοινωνικά δίκτυα, σε συνδυασμό με τη δυνατότητα να εντοπίσει και να στοχεύσει συγκεκριμένα προφίλ σημαίνει πως πλέον δημιουργεί προσωποποιημένα fake news. Ερευνα δείχνει έναν ακόμη μεγαλύτερο κίνδυνο, να πιστέψουν τα άτομα σε ψευδείς αφηγήσεις όταν τα μηνύματα εξατομικεύονται με βάση τα δημογραφικά στοιχεία ενός ατόμου.

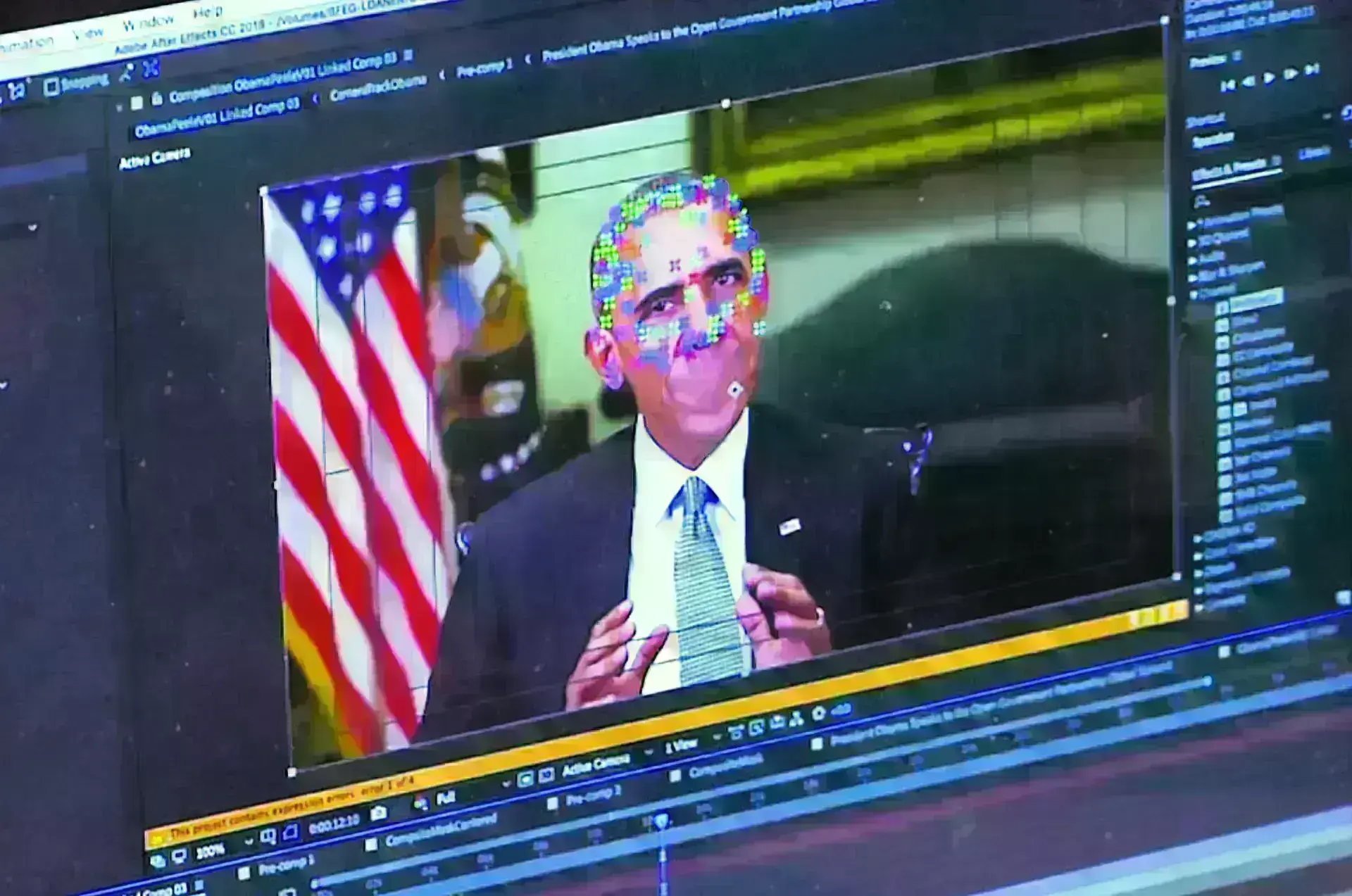

Η απειλή του deep fake

Μοιάζει και μιλάει σαν τον Ομπάμα, αλλά δεν είναι…

Θέλετε να ακούγεστε σαν τον Μπαράκ Ομπάμα; Στο παρελθόν, αυτό ίσως απαιτούσε κάποιον μίμο. Αλλά η τεχνολογία έχει αλλάξει τα δεδομένα. Τώρα σχεδόν ο οποιοσδήποτε έχει βασικές γνώσεις χρήσης τεχνολογικών εργαλείων και σύνδεση στο Ιντερνετ μπορεί εύκολα και με ακρίβεια να «αναπαραστήσει» οποιονδήποτε και να πει οτιδήποτε μέσω της ΑΙ. Αρκεί να χρησιμοποιήσετε την υπηρεσία ενός διαδικτυακού προγράμματος για να ηχογραφήσετε μία πρόταση και να ακούσετε τι είπατε με τη φωνή ενός διάσημου προσώπου.

Προγράμματα όπως αυτό συχνά αποκαλούνται deep fakes συστήματα Τεχνητής Νοημοσύνης που προσαρμόζουν τον ήχο, τις εικόνες και τα βίντεο για να κάνουν τους ανθρώπους να λένε και να κάνουν πράγματα που δεν έκαναν ποτέ. Αυτή η τεχνολογία μπορεί να σημάνει μία νέα εποχή στις ψευδείς ειδήσεις, ακόμα και να οδηγήσει σε «κούρσα εξοπλισμών» από κομματικά επιτελεία εν όψει εκλογικών διαδικασιών.

Για παράδειγμα, τον Μάρτιο του 2023, ενώ τα μέσα ενημέρωσης ανέφεραν ότι ο Ντόναλντ Τραμπ μπορεί να κατηγορηθεί για παραποίηση επιχειρηματικών αρχείων, ο Ελιοτ Χίγκινς, ιδρυτής της ομάδας ερευνητικής δημοσιογραφίας «Bellingcat», μοιράστηκε στο Twitter εικόνες που δημιούργησε χρησιμοποιώντας εργαλείο εικόνων ΑΙ. Οι εικόνες φαινόταν ότι δείχνουν τον Τραμπ να συλλαμβάνεται. Ο Χίγκινς δήλωσε σαφώς ότι οι εικόνες δημιουργήθηκαν με Τεχνητή Νοημοσύνη, αλλά γρήγορα κοινοποιήθηκαν χωρίς αυτό το πλαίσιο, σε μία περίπτωση με τη λεζάντα: «#BREAKING: Ο Ντόναλντ Τραμπ συνελήφθη στο #Μανχάταν σήμερα το πρωί!».

Καταπολέμηση

Οι ερευνητές σημειώνουν πως το ίδιο όπλο μπορεί να στραφεί στον εαυτό του. Η Τεχνητή Νοημοσύνη έχει πολλά ηθικά ζητήματα, ωστόσο ενίοτε μπορεί να είναι η λύση και να χρησιμοποιηθεί για την καταπολέμηση της παραπληροφόρησης. ‘Ηδη «τρέχουν» προγράμματα που στόχο έχουν να χτίσουν εργαλεία που θα βοηθούν δημοσιογράφους και ερευνητές επιβεβαίωσης ειδήσεων (fact checkers) να εντοπίσουν την ψευδή είδηση. Τo GoodNews είναι ένα τέτοιο πρόγραμμα, καθώς η ΑΙ χρησιμοποιείται ως άτυπη προσέγγιση για την ανίχνευση ψευδών ειδήσεων.

Μία πανεπιστημιακή έκθεση στη Βρετανία ζήτησε να διδάσκονται οι άνθρωποι πώς να εντοπίζουν τις τεχνητές νοημοσύνες πριν από τις γενικές εκλογές (σ.σ.: το 2025). Αλλωστε εκτιμάται πως το 80% του πληθυσμού επηρεάζεται από τις ψευδείς ειδήσεις. Η έκθεση του Ινστιτούτου για την Ανθρωποκεντρική ΑΙ του Πανεπιστημίου του Σάρεϊ συνιστά επίσης μεγαλύτερη χρηματοδότηση για την έρευνα σχετικά με την ανίχνευση των deepfakes.

Πέντε ερωτήματα επαλήθευσης

1. Ποια είναι η πηγή της πληροφορίας; Είναι αξιόπιστη;

2. Υπάρχουν συγκρουόμενα συμφέροντα για την πληροφορία, την πώληση του προϊόντος ή της υπηρεσίας; Ανιχνεύεις κάποιο κίνητρο;

3. Είναι η πληροφορία η άποψη ή το σχόλιο κάποιου;

4. Υπάρχουν αξιόπιστα στοιχεία για τους ισχυρισμούς;

5. Εχετε συγκεκριμένες πεποιθήσεις ή προτιμήσεις που μπορεί να επηρεάσουν την κρίση σας;

ΠΟΙΑ ΕΠΑΓΓΕΛΜΑΤΑ ΘΑ ΕΠΗΡΕΑΣΤΟΥΝ ΠΕΡΙΣΣΟΤΕΡΟ

Η Φραν Ντρέσνερ, η θρυλική τηλεοπτική «νταντά», πήρε το όπλο της πέρυσι. Ως πρόεδρος της συνομοσπονδίας ηθοποιών των ΗΠΑ στάθηκε στο πλευρό της ένωσης σεναριογράφων στον μαραθώνιο πολύμηνο απεργιακό αγώνα για την προάσπιση της εργασίας τους από την επέλαση της Τεχνητής Νοημοσύνης. «Κινδυνεύουμε όλοι να μας αντικαταστήσουν οι μηχανές» φώναζε.

Ρομπότ συγγραφείς, παρουσιαστές ειδήσεων είναι ήδη εδώ και μιμούνται το έργο των δημιουργών. Το Χόλιγουντ το είχε προβλέψει προ πολλού σε πάμπολλα θρίλερ επιστημονικής φαντασίας. Οι μηχανές με Τεχνητή Νοημοσύνη θα αρπάξουν τα ηνία και θα καταστρέψουν την ανθρωπότητα.

Η «προφητεία» δεν είναι ανάγκη να εκπληρωθεί, καθησυχάζουν ειδικοί. Η Τεχνητή Νοημοσύνη έχει εισβάλει με φόρα και στην αγορά εργασίας. Μείναμε άναυδοι τελευταία μεταξύ άλλων και με το «θαύμα» του ChatGPT, την εφαρμογή που λάνσαρε τον Νοέμβρη του 2022 η OpenAI, που παράγει κείμενα και απαντά σε ερωτήσεις.

Υπερβολές

Ωστόσο μάλλον ο φόβος είναι υπερβολικός. Δεν κινδυνεύουμε να χάσουμε όλοι τις θέσεις εργασίας μας. Η περίοδος μετάβασης μπορεί να έχει αναταράξεις, αλλά νέες ισορροπίες θα βρεθούν, διαβεβαιώνουν ειδικοί της Ευρωπαϊκής Κεντρικής Τράπεζας όπως η Στεφανία Αλμπανέζι.

Η Ιστορία δείχνει πως στον δρόμο της τεχνολογικής προόδου υπήρξαν μετωπικές συγκρούσεις μεταξύ καινοτομίας και αγοράς εργασίας. Η αυτοματοποίηση «απέλυσε» κυρίως τους εργάτες του «μπλε κολάρου», θέσεις εργασίας καταργήθηκαν, αλλά νέα επαγγέλματα δημιουργήθηκαν (οδηγοί άμαξας έγιναν εργάτες στα εργοστάσια της Ford) και η δουλειά μας έγινε πιο εύκολη, γίναμε πιο παραγωγικοί όταν έφυγε από τις πλάτες μας το βάρος μονότονων επαναλαμβανόμενων υποχρεώσεων, επισημαίνει ο Πίτερ Κουίγκλεϊ, διευθύνων σύμβουλος της «Kelly Services», αμερικανικής εταιρίας στελέχωσης γραφείων που δραστηριοποιείται παγκοσμίως.

Στοιχεία-σοκ

Για την ώρα τα νούμερα τρομάζουν. Ρομπότ ΑΙ ίσως καλύψουν μέχρι το 2030 το 30% των θέσεων εργασίας που σήμερα κατέχουν άνθρωποι, σύμφωνα με έκθεση της «McKinsey». Υπολογίζεται πως μέχρι και 800 εκατομμύρια θέσεις εργασίας κινδυνεύουν από την αυτοματοποίηση και 375 εκατομμύρια εργαζόμενοι θα πρέπει να αλλάξουν τομέα.

Σύμφωνα με την «Goldman Sachs» εργαλεία όπως το ChatGPT μπορεί να επηρεάσουν 300 εκατομμύρια θέσεις εργασίας παγκοσμίως την επόμενη δεκαετία. Το παγκόσμιο ΑΕΠ θα αυξηθεί κατά 7% και η παραγωγικότητα κατά 1,5%. «Οι περισσότεροι τομείς της αγοράς εργασίας είναι εκτεθειμένοι στην αυτοματοποίηση, αλλά η Τεχνητή Νοημοσύνη θα έχει τελικά μάλλον συμπληρωματικό ρόλο» σύμφωνα με την έκθεση της «Goldman Sachs». Ενας ακτινολόγος έχει πιο γρήγορα, αξιόπιστα δεδομένα στα χέρια του, ο συντάκτης ενός δελτίου Τύπου μειώνει κατά 40% τον χρόνο που επενδύει και αυξάνει την ποιότητα κατά 18% σύμφωνα με έρευνα στο ΜΙΤ

Εκτός από τη μεγάλη ταχύτητα (το Instagram χρειάστηκε σχεδόν δυο χρόνια να αποκτήσει 10 εκατομμύρια χρήστες, ενώ το ChatGPT σε δυο μήνες είχε 100 εκατομμύρια), η ειδοποιός διαφορά στην περίπτωση της ΑΙ είναι πως περικυκλώνει και τις θέσεις εργασίας των υπαλλήλων «λευκού κολάρου» που μέχρι πρότινος θεωρούνταν ασφαλείς, δηλαδή δεν απειλείται μόνο η χειρωνακτική εργασία ρουτίνας αλλά και η «δημιουργική εργασία».

Μέσα στην αναταραχή πολλοί φοβούνται πως θα ενισχυθούν οι ανισότητες, τα μεγαλύτερα θύματα της μετάβασης μπορεί να είναι γυναίκες και μειονότητες, που εργάζονται κατά κανόνα ως γραμματείς και διοικητικοί υπάλληλοι που είναι πιο χαμηλά στη σκάλα της ιεραρχίας.

Τα επαγγέλματα που θα επηρεαστούν περισσότερο, σύμφωνα με έρευνα του Πανεπιστημίου της Πενσιλβάνια, περιλαμβάνουν λογιστές, φοροτεχνικούς, οικονομικούς αναλυτές, δημοσιογράφους, μεταφραστές, σχεδιαστές ιστοσελίδων. Η «McKinsey» προσθέτει εργαζόμενους στην εξυπηρέτηση πελατών, στις πωλήσεις λιανικής, στην εστίαση.

Από την άλλη, σύμφωνα με έκθεση του Παγκόσμιου Οικονομικού Φόρουμ, στην εποχή της Τεχνητής Νοημοσύνης μέχρι το 2027 προβλέπεται αύξηση 30%-40% στις θέσεις αναλυτών δεδομένων ή ειδικών στην κυβερνοασφάλεια. Ο άνθρωπος θα έχει ακόμη τον πρώτο λόγο, αφού θα τροφοδοτεί και θα επιβλέπει τις πλατφόρμες ΑΙ.

«Συναγερμός» για την εθνική ασφάλεια

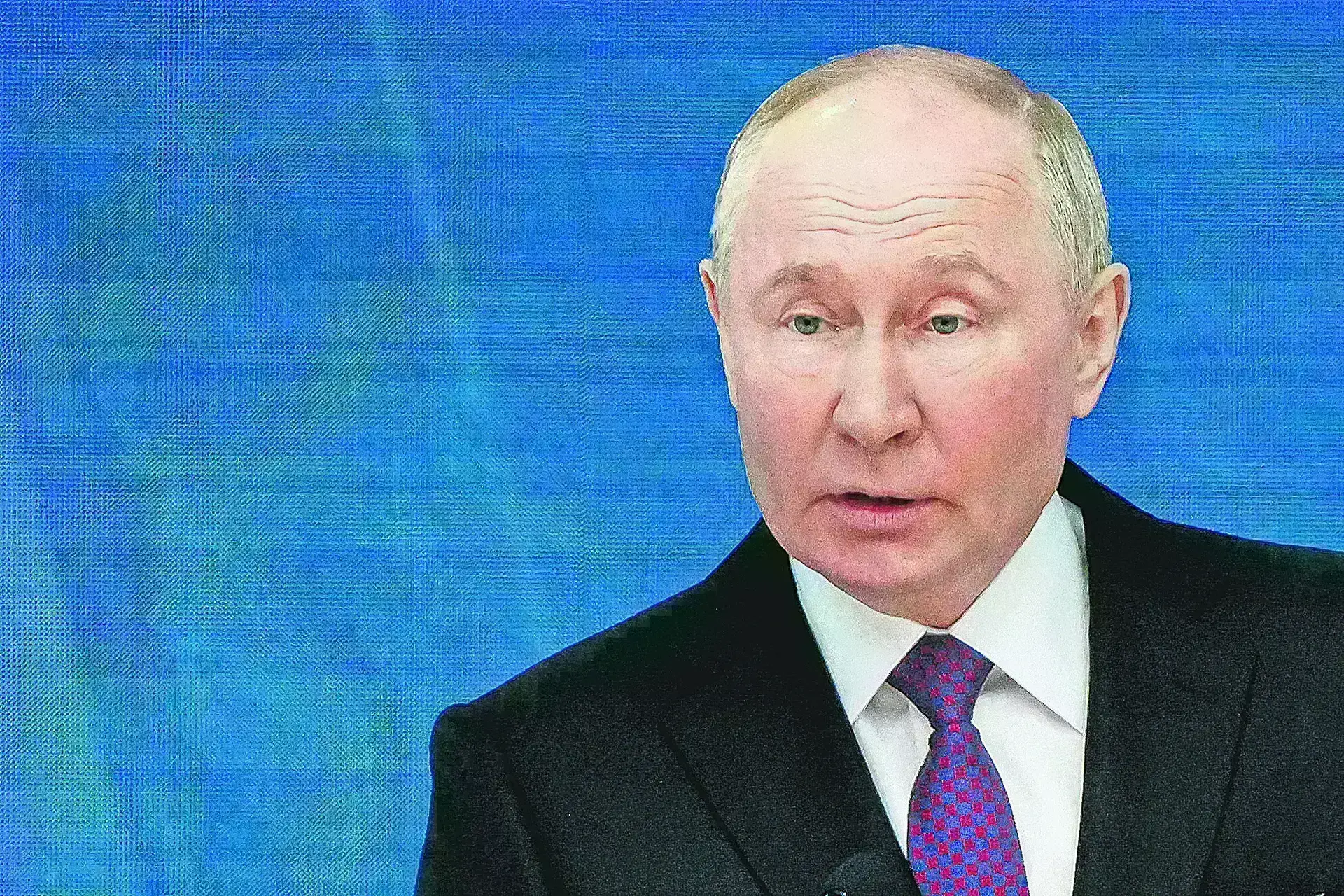

Πέρασαν επτά χρόνια από τη στιγμή που -σε σχετικά ανύποπτο χρόνο- ο Βλαντιμίρ Πούτιν διακήρυσσε πως «όποιος γίνει ηγέτης στον χώρο της Τεχνητής Νοημοσύνης θα κυριαρχήσει και στον πλανήτη».

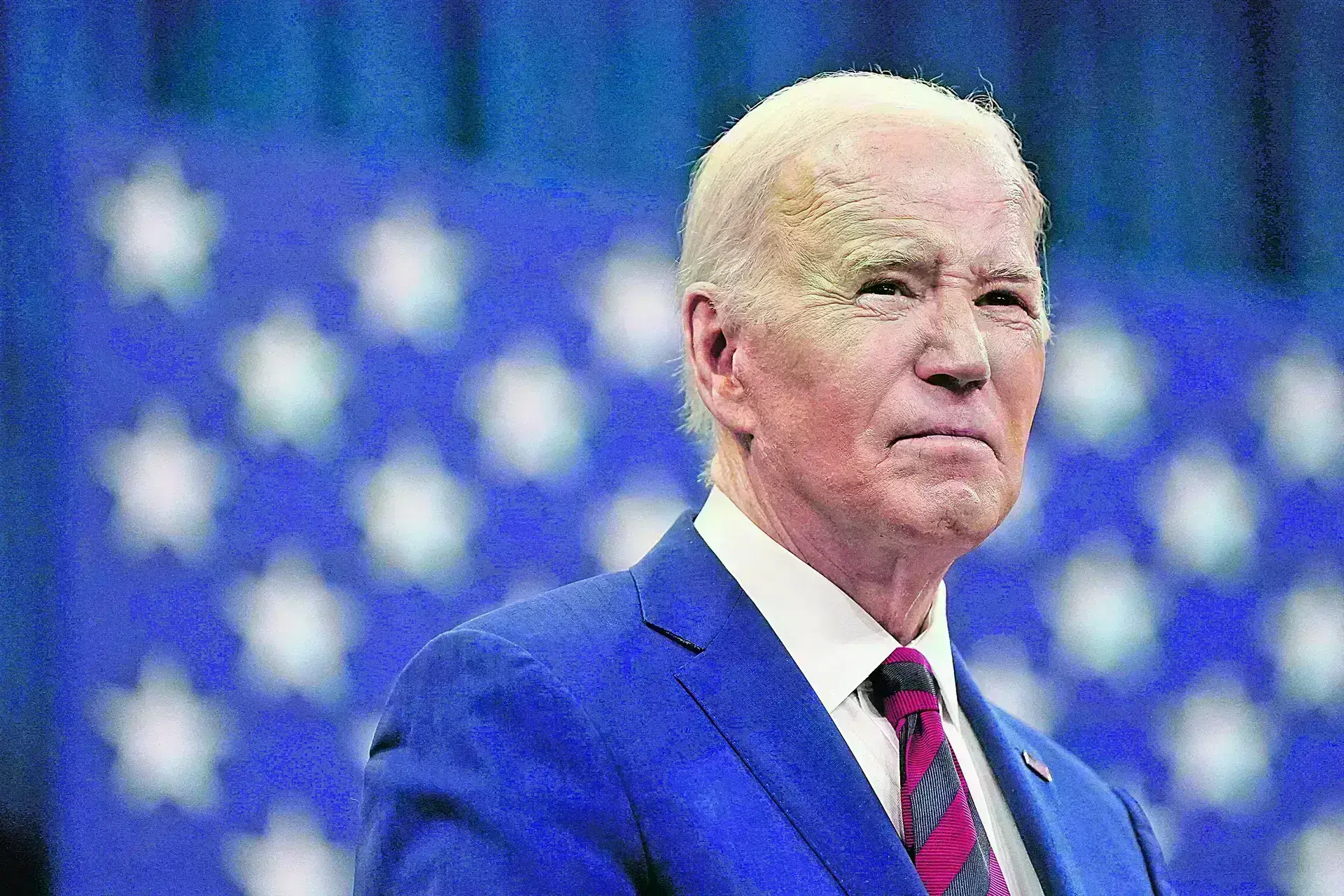

Πριν από περίπου έναν χρόνο ο Λευκός Οίκος εξέδωσε εκτελεστικό διάταγμα προς τις υπηρεσίες ασφαλείας για την προστασία των ΗΠΑ, των τηλεπικοινωνιών και της οικονομίας τους από την ανερχόμενη απειλή της Τεχνητής Νοημοσύνης.

Η νομοθετική πρωτοβουλία περιγράφηκε από τους Τζο Μπάιντεν και Καμάλα Χάρις ως «η πιο αποτελεσματική και καθολική μορφή δράσης που έχει αναληφθεί έως τώρα για την προστασία των Αμερικανών από τους κινδύνους των συστημάτων Α.Ι.». Στην πράξη λειτουργεί σαν μπούσουλας για τις ομοσπονδιακές υπηρεσίες, προκειμένου αυτές να θεσπίσουν επαρκείς κανόνες ασφαλείας για την αντιμετώπιση απειλών από αντίπαλα κράτη, εις βάρος των χημικών, βιολογικών, ακτινολογικών, πυρηνικών δικτύων, καθώς και των συστημάτων κυβερνοασφάλειας της Αμερικής.

Σε αυτό το πλαίσιο εντάσσεται η επικήρυξη επτά Κινέζων χάκερ από το αμερικανικό υπουργείο Δικαιοσύνης, την περασμένη Δευτέρα, έναντι 10 εκατ. δολαρίων. Αυτός ο «μικρός στρατός» του Πεκίνου κατηγορείται για συστηματικό χακάρισμα εκατομμυρίων κρατικών, αλλά και ιδιωτικών e-mails, ιστοσελίδων και λογαριασμών στις ΗΠΑ τα τελευταία 14 χρόνια, με ανάλογη δράση στη Βρετανία (εις βάρος βουλευτών), καθώς και σε άλλες δυτικές χώρες.

Μέριμνα

Επειδή όμως κίνδυνοι δύνανται να προκύψουν και εντός των τειχών, η κυβέρνηση Μπάιντεν μερίμνησε για το εξής: Οι αμυντικές εταιρίες που αναπτύσσουν μεγάλης κλίμακας συστήματα Α.Ι., ικανά να θέσουν σε κίνδυνο την εθνική ασφάλεια, υποχρεούται πλέον να μοιράζονται τα αποτελέσματα των σχετικών τεστ με την αμερικανική κυβέρνηση, παραβλέποντας το «επιχειρηματικό απόρρητο».

«Σε λάθος χέρια η Α.Ι. μπορεί να διευκολύνει τους χάκερ να εκμεταλλευτούν τις αδυναμίες του λογισμικού που εξασφαλίζει την εύρυθμη λειτουργία της κοινωνίας μας», υπογράμμισε ο πρόεδρος των ΗΠΑ. «Γι’ αυτό εξουσιοδοτώ το υπουργείο Αμυνας και το υπουργείο Εσωτερικής Ασφάλειας να αναπτύξουν συστήματα κυβερνοπροστασίας, που θα διασφαλίσουν ότι τα κομπιούτερ μας και οι κρίσιμες υποδομές μας θα γίνουν ασφαλέστερες απ’ ό,τι είναι τώρα».

Η αμερικανική κυβέρνηση δεν έκρυψε ακόμη ότι φιλοδοξεί να εργαστεί προς τη θέσπιση διεθνών κανόνων για την Τεχνητή Νοημοσύνη. Στόχος, όπως υπογράμμισε ο υπουργός Εσωτερικής Ασφάλειας, Αλεχάντρο Μαγιόρκας, είναι να μειωθεί ο κίνδυνος από τη χρήση της Α.Ι. στην κατασκευή όπλων μαζικής καταστροφής, από την αξιοποίησή της για την κλοπή πνευματικής ιδιοκτησίας και η προσέλκυση των καλύτερων μυαλών απ’ όλο τον κόσμο που θα συμβάλουν στην ανάπτυξη «υπεύθυνης Α.Ι.» στις ΗΠΑ

Προσομοίωση σε… Κούβα και Ουκρανία

«Φανταστείτε πώς θα ήταν η Κρίση των Πυραύλων στην Κούβα το 2030, με όλες τις πλευρές να χρησιμοποιούν μια ευρεία γκάμα εφαρμογών Τεχνητής Νοημοσύνης, από την αναγνώριση εικόνων έως τη διαχείριση logistics και τη δημιουργική ανάλυση των προθέσεων του αντιπάλου», ανέπτυξε πέρσι τον Σεπτέμβριο ως σενάριο ο αναλυτής του think tank CSIS, Mπέντζαμιν Τζένσεν, σε επιτροπή του Κογκρέσου. Κατά την άποψή του, η χρήση τόσο υψηλής τεχνολογίας μάλλον θα επιτάχυνε την κρίση οδηγώντας σε άσχημα αποτελέσματα, ενώ θα ήταν πιο λογικό να επιβραδυνθούν κάπως τα πράγματα και να δοθεί χρόνος στη λήψη αποφάσεων, όπως και έγινε. Από αυτήν την άποψη, ήταν ευτύχημα που οι Τζον Κένεντι και Νικίτα Χρουστσόφ διέθεταν πρωτόγονη τεχνολογία κυβερνο-πληροφορικής το 1962 και, έτσι, η ανθρωπότητα γλίτωσε από το πυρηνικό ολοκαύτωμα.

Η άλλη όψη

Από την άλλη πλευρά, υποστηρίζει ο Τζένσεν, όσοι αργήσουν να προσαρμοστούν στις νέες συνθήκες θα πληρώσουν βαρύτερο τίμημα αίματος στα μελλοντικά πεδία των μαχών. Η πλευρά που θα διαθέτει το ταχύτερα προσαρμοζόμενο μοντέλο Τεχνητής Νοημοσύνης θα εξασφαλίσει πλεονέκτημα χρόνου και μεγαλύτερη ελευθερία δράσης. Αυτό, κατά την άποψή του, αποδείχθηκε και στην Ουκρανία.

Eκεί ένα δίκτυο αποτελούμενο από πολίτες μηχανικούς λογισμικού, στρατιωτικούς και μη κερδοσκοπικές ενώσεις κατασκεύασε την πλατφόρμα Delta, που τους επέτρεπε να εκσυγχρονίζουν εν κινήσει τη χρήση Τεχνητής Νοημοσύνης στο πεδίο της μάχης, ενόσω έκαναν πόλεμο επιβίωσης. Το πλεονέκτημά τους ήταν ότι είχαν την άνεση να πειραματίζονται συνεχώς και να αποτυγχάνουν. Μια πολυτέλεια, όμως, που σίγουρα δεν έχουν οι στρατοί των ΗΠΑ, της Ρωσίας και της Κίνας.